Intelligenter Synthesizer von Google

Eigentlich als Suchmaschine gestartet, nimmt der Einfluss von Google stets weiter zu. Jetzt startet der amerikanische Internet-Riese auch im Bereich der Synthesizer durch. Zusammen mit der Firma Magenta wurde ein Open Source Projekt entwickelt, das (zunächst) als kostenloses DIY-Projekt Bastlern zur Verfügung steht. Das Ganze lautet auf den Namen NSYNTH SUPER.

NSYNTH SUPER ist eine Mischung aus Sampleplayer und Synthesizer. Man lädt seine eigenen Sounds in den NSYNTH, dieser analysiert diese und mit Hilfe von komplexen Berechnungen lassen sich Charakter und Timbre der Sounds steuern und verändern, so entstehen die unterschiedlichsten Klänge. Laut Website des Herstellers wurde der NSYNTH SUPER zunächst mit 15 verschiedenen Sounds gespeist, daraus entwickelte das Gerät über 100.000 neue Klänge.

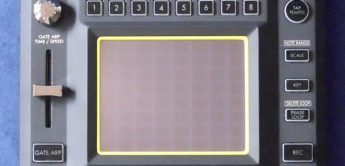

Alles wird beim NSYNTH SUPER über vier große und fünf kleine Potis sowie einen Touchscreen gesteuert. Hier ein erste Überblick, wie sich das in der Praxis gestaltet:

Sie sehen gerade einen Platzhalterinhalt von Youtube. Um auf den eigentlichen Inhalt zuzugreifen, klicken Sie auf die Schaltfläche unten. Bitte beachten Sie, dass dabei Daten an Drittanbieter weitergegeben werden.

Wie im Video zu sehen, lassen sich auch unterschiedliche Basis-Sounds miteinander morphen und mischen, so dass teilweise recht neuartige Sounds entstehen.

Sie sehen gerade einen Platzhalterinhalt von Youtube. Um auf den eigentlichen Inhalt zuzugreifen, klicken Sie auf die Schaltfläche unten. Bitte beachten Sie, dass dabei Daten an Drittanbieter weitergegeben werden.

Wie eingangs bereits erwähnt, ist NSYNTH ein Open Source Projekt, d.h. jeder darf sich die Anleitungen und Skripte hierfür kostenlos von der Entwicklerseite herunterladen. Da es bisher noch keine fertige Hardware dafür gibt, muss auch diese zunächst selbst entwickelt bzw. gebaut werden. Interessant, wir sind gespannt, wo die Reise mit Googles NSYNTH SUPER hingeht.

Mich würde interessieren, wie Google da Daten sammeln kann?

@JohnDrum Das war tatsächlich auch mein erster Gedanke. Lassen wir uns überraschen.

Ein hochinteressantes Konzept und eine zeitgemäße Bedienung. Hut ab. Das haben sich die Platzhirsche bisher nicht getraut. Sexy Touchscreen kombiniert mit tollen Drehreglern.

Inwieweit beim Spielen direkt Daten abgegriffen werden und ob das Gerät offline zu gebrauchen ist, bleibt zu klären.

100.000 Kombinationen heißt nicht 100.000 brauchbare Sounds. Ich sag nur: Preset-Overkill. Viel Spass beim Durchhören.

Interessantes Konzept …

Der Ansatz, Samples zu analysieren und dynamisch mehr oder weniger stark verfremdet wiederzugeben, erinnert mich an den Hartmann Neuron. Mal sehen, was sich noch daraus entwickelt – leider bin ich selbst alles andere als ein Bastler oder Programmierer, aber ich werde das Projekt auf jeden Fall im Auge behalten.

Falls es tatsächlich das Ziel dieses Projektes ist, aus „ungefähr-Sample-Vorgaben“ intuitiv eigene Soundvorstellungen umsetzen zu können, dann könnte sich damit eine Revolution anbahnen. Meines Erachtens ist der Schwachpunkt der ganzen Synthesizer-Branche, immerzu vorauszusetzen, dass wer Synthesizer-Sounds musikalisch nutzen will, auch wissen sollte, wie sie entstehen. So wird ein riesiges Potential verschenkt. Einen Synthesizer kauft in der Regel nur, wer bereit ist, in dieses ganze Hüllkurven-, Filter- und Oszillator-Gedöhns einzusteigen. Das ist ungefähr so, als könnten nur die Leute Software nutzen, die sie auch programmieren können. Deshalb empfand ich auch den NL A1 als richtigen Ansatz: Man hat versucht, das alles ein bisschen zu vereinfachen. Und das ist auch gelungen, aber eben nur ein kleines bisschen ansatzweise. Früher oder später wird die Entwicklung in die Richtung gehen, Soundvorstellungen aus dem Kopf ohne tiefgehendes Fachwissen Realität werden zu lassen.

Hallo Andreas,

nur das du beim NL A1 Teil des kreativen Prozesses bist und hier beim Google potentiell Gefahr läufst das die Maschine ihr Ding durchzieht und du nur noch klingt gut oder gefällt mir nicht bewertest. Und die Maschine das lernt. Nur weil ich weiss wie eine Schwingung funktioniert, bin ich noch nicht in der Lage Musik zu machen. Oder musikalisch nutzbare Klänge zu erzeugen. Und andersrum ist das Ergebnis der Berechnung meiner Idee oder der KI entsprungen? Siehe auch Clarksche Gesetze „Jede hinreichend fortschrittliche Technologie ist von Magie nicht zu unterscheiden.“ Ich hab die Beispiele gehört und hatte „Daisy Bell“ auf einer IBM 7094 im Kopf. Kann man mal machen. Ich sehe hier noch keinen adäquaten Ansatz zu Massentauglichlichkeit oder das zukünftig kein Expertenwissen mehr nötig sein sollte.

es geht hier nicht direkt um das Sammeln von Daten, sondern Google braucht Leute die das Neuronale Netzwerk mit Vorgaben füttern um maschinelles Lernen zu verbessern. Es geht darum den Kreativen Prozess von Menschen, hier das erstellen von Sounds in einem musikalischen Kontext, der KI von Google bei zu bringen.

Ich bin da ganz bei Elon Musk, und würde den Teufel tun und Google auf den ach so tollen kreativen Leim zu gehen.

Sorry, aber vielleicht gehören Hingabe und Lernen dazu um ein Instrument zu beherrschen, bei einem Synthesizer eben auch das Sounddesign.

@stacoja Da hat Dich doch tatsächlich das Wort „Google“ im Titel getriggert.

man kann einen synthesizer als preset-schleuder benutzen, und das ist auch okay. wieviele hits haben nicht standard-presets und -sounds benutzt?

mich hat über diese sounds hinaus aber immer der direkte eingriff in den klang interessiert. und der macht so viel spaß, dass er manchmal zum selbstzweck wird.

Google schlägt Behringer mit einem Farbdisplay und Touchscreen mit Internet Verbindung und eingebauter Datenkrake. Voll digital, bin gespannt was noch kommt. Eine Metal Gitarre oder ein singender Sprachcomputer der angeblich sinnvolle Texte aus Facebook klaut und deinen Song selbst komponiert. Ich bin da wirklich zu altmodisch dafür. Für was hab ich mich jahrelang spielen gelernt und jetzt kommt Google daher und will das Wissen der Menschheit zu einem Song zusammen fassen?

Schonwieder die Behringer-Connection, wie ermüdend. BTW, schau doch mal in der Suchmaschine deiner Wahl nach Stichworten wie „Deepmind“, „Augmented Reality“, „Synthmeet Sheffield“ etc.

YEP, und Behringer ist noch immer in der der analogen Steinzeit gefangen, innovativ geht aber anders und nämlich so: OK, Google!!!!

Ich liebe Open Source Projekte, finde das ganze eine gute Idee. Trotzdem macht mir Google Angst…

Ein „Synthesizer“ von Google. Haha. Irgendwie ist das wie…ein Sportwagen von Melitta. Dessous von Bauhaus…Scherz beiseite, das Ding macht vermutlich nichts anderes als Wellenformen, Frequenzen und Transienten zu analysieren und ermöglicht es, diese dann zu verändern bzw. sie werden automaisiert verändert, da kommen schnell mal 100.000 Sounds zusammen. An einem PlugIn im Hardware-Gewand ist ja prinzipiell nichts auszusetzen.

Das wird vor allem bei den Herstellern für gehörig Unruhe sorgen, die geglaubt haben uns mit völlig langweiligen, massiv überholten Konzepten abzuzocken. Wenn das wirklich so innovativ ist, werden dass alle ausprobieren, die nicht nur im gestern unterwegs sein wollen – mich eingeschlossen. Aber da Google nicht der Verein für Selbstloses Handeln ist, sollte man sehr genau schauen was dahinter steckt und was die vorhaben. In den Labs von Google arbeiten ne Menge extrem intelligenter Leute mit wirklich tollen, zukunftsweisenden Ideen, die höchtwarscheinlich erstmal nur an Innovation interessiert sind. Im Film sieht man das ganz gut. Ich vermute diese Gerät ist noch nicht die KI fütternde Datenkrake. Man sollte halt mal ein paar Sniffer aufstellen und schauen ob und was gesendet wird. Ernst wirds ganz sicher wenn die Masse mit solchen Toys bedient wird, vorallem wenn sie verdächtig günstig werden – davon kann man ausgehen. Oder wenn’s den Nsyth als Plugin gibt … dann hängt das Teil in der eigenen Infrastruktur drin.

Man muss sich halt bewusst sein dass man bei allem was Gratis angeboten wird (Google, Facebook, Whatsapp….) als Konsument zur eigentlichen Ware wird.

Interessant ist das Projekt aber trotzdem.

Wenn sie´s jetzt noch schaffen, das Ding nicht nach billigem Vocoder klingen zu lassen, wirds bestimmt Megadufte.

Aber auch hier wieder das Grundproblem:

Nicht genug Operatoren für die Resynthese…

Selbst bei Alchemy mit seinen 600 möglichen Sinusoperatoren ist das viel zu wenig um überzeugend zu klingen.

20.000 müssten es sein – das kann dann aber kein kleines Desktopkästchen mehr berechnen.

Da bräuchte es dann einen Großrechner.

@TonvaterJan Wenn es um additive Resynthese geht, hast du sicher Recht – aber ich fühlte mich beim Lesen dieser News, wie schon in meinem ersten Kommentar hier erwähnt, mehr an die NEURONALE Resynthese des besagten Hartmann-Synthesizers erinnert. Dort wird der Klang beim Wiederzusammensetzen mehr nach der Art von Physical Modeling generiert, nur dass da die Bestandteile eines konkreten Samples als Ausgangsbasis dienen und keine ultimative Natur-Imitation angestrebt ist.

Natürlich braucht gerade auch diese Form der Resynthese enorme Rechenleistung, aber die Computertechnik hat sich in den vergangenen 13 bis 16 Jahren weiter entwickelt, so dass jetzt womöglich auch ein einfacher ARM-Prozessor brauchbare Ergebnisse liefern kann.

Wer Angst vor Google hat sollte sich bewusst machen, dass es sich um ein Open Source Projekt handelt, und man einfach prüfen kann ob und wenn ja was an den Konzern geschickt wird.

Ich würde Mal vermuten: Gar nichts, und das ist nur ein Testballon/Proof of Concept für weitere Produkte, die auf ähnliche Technik setzen werden, welche dann aber in anderen Bereichen zum Einsatz kommen.

Musiker sind als einzelne Zielgruppe viel zu uninteressant.

@fkdiy Natürlich hast du Recht. Allerdings sieht es in der Praxis so aus, dass wohl die wenigsten die Zeit und Vorfällen auch das notwendige know-how haben, sich denn kompletten Quellcode durchzuschauen und auch zu verstehen (TOR ist auch Open Source und trotzdem hat fast keiner eine Ahnung, wie das ganze genau funktioniert). Allerdings ist es IMO in diesem Fall nicht nötig sich Sorgen zu machen, da nicht alles was von Google kommt auch automatisch der Spionage dient. Haben sie gar nicht mehr nötig, da die Infrastruktur zur Überwachung schon steht. Außerdem wird dieses Produkt ja auch was kosten(im Gegensatz zur Suchmaschine). Da machen mir die Forschungen an KI und Gedanken-Erfassung schon mehr Sorgen. Ich freue mich zu sehen das ein Mega Konzern wie Google sich überhaupt in dem Bereich beschäftigt und versucht neue Konzepte zu verwirklichen. Sowas hätte ich eigentlich von einem kleinem Startup Unternehmen erwartet. Besser als ein weiterer Analoger Monosynth mit features die schon vor 30 Jahren Standard waren. Ich hoffe das es mehr wird als eine preset Schleuder. Könnte mir vorstellen das mit der Hardware auch andere Formen der Synthese Möglich sind. Evt lässt sich der Bildschirm/Touch Screen auch sinnvoller nutzen, zb wie ein Plugin nur halt als Hardware!

Zum Glück sind wir alle Herren über unsere Internetverbindung, oder? Ich habe jetzt schon Angst davor, wie die MIDI-Note-Informationen meines nächsten Welthits für neuronale Netze missbraucht werden.

Also ich finde es einfach blöd. Punkt. Was hat das mit dem Musik machen zu tun? Google ist kein Musiker. Google ist ein Unternehmen das sich nicht um das Wohl der Menschen kümmert, eher um seinen eigenes Wohl. Ich bin total kontra eingestellt.

Alle grossen Unternehmen tun dies und müssen das auch tun, und auch Behringer interessiert nur eines am Ende des Bilanzjahres: Wie gross ist max. mögliche :PROFIT!